L’analyse globale des risques (AGR) pour répondre aux exigences de l’IA Act

![]() Les systèmes d’IA connaissent actuellement un essor majeur dans tous les domaines de nos sociétés et sont sources d’opportunités dont probablement la majorité ne sont pas encore identifiées.

Les systèmes d’IA sont : (i) fondés des modèles mathématiques et des algorithmes dont la complexité rend difficile voire impossible une analyse formelle de leur fonctionnement ; (ii) utilisés pour prédire, générer des informations (textes, images, sons, codes, événements…) et prendre des décisions, avec de moins en moins de supervision humaine. Les prédictions et décisions générées par ces systèmes, quelles qu’elles soient, sont assorties d’incertitudes qui, si elles sont caractérisables par des métriques de performances, sont en revanche difficilement quantifiables, décelables et même reproductibles en utilisation opérationnelle. Par ailleurs, ces systèmes peuvent être intentionnellement orientés/biaisés à des fins politiques ou commerciales mais aussi utilisés pour générer des attaques cyber.

En réponse à ces enjeux majeurs qui bouleversent nos sociétés, et à l’instar du RGPD en 2016, l’Union Européenne a depuis 2021 développé l’AI Act, premier cadre juridique au monde visant vise à fournir un cadre explicite aux développeurs et deployeurs d’IA en Europe en formulant des exigences et des obligations qui dépendent de la nature et des objectifs du système d’IA concerné. On peut regretter au passage que les dommages environnementaux que pourraient générer des systèmes d’IA n’aient pas été considérés. Cette réglementation entre en vigueur en mai 2024.

Ce cadre réglementaire est construit sur une approche par la gouvernance, l’analyse et la maîtrise des risques.

Les systèmes d’IA connaissent actuellement un essor majeur dans tous les domaines de nos sociétés et sont sources d’opportunités dont probablement la majorité ne sont pas encore identifiées.

Les systèmes d’IA sont : (i) fondés des modèles mathématiques et des algorithmes dont la complexité rend difficile voire impossible une analyse formelle de leur fonctionnement ; (ii) utilisés pour prédire, générer des informations (textes, images, sons, codes, événements…) et prendre des décisions, avec de moins en moins de supervision humaine. Les prédictions et décisions générées par ces systèmes, quelles qu’elles soient, sont assorties d’incertitudes qui, si elles sont caractérisables par des métriques de performances, sont en revanche difficilement quantifiables, décelables et même reproductibles en utilisation opérationnelle. Par ailleurs, ces systèmes peuvent être intentionnellement orientés/biaisés à des fins politiques ou commerciales mais aussi utilisés pour générer des attaques cyber.

En réponse à ces enjeux majeurs qui bouleversent nos sociétés, et à l’instar du RGPD en 2016, l’Union Européenne a depuis 2021 développé l’AI Act, premier cadre juridique au monde visant vise à fournir un cadre explicite aux développeurs et deployeurs d’IA en Europe en formulant des exigences et des obligations qui dépendent de la nature et des objectifs du système d’IA concerné. On peut regretter au passage que les dommages environnementaux que pourraient générer des systèmes d’IA n’aient pas été considérés. Cette réglementation entre en vigueur en mai 2024.

Ce cadre réglementaire est construit sur une approche par la gouvernance, l’analyse et la maîtrise des risques.

- Gouvernance des risques : cadre de décision et référentiel d’acceptabilité et d’acceptabilité du risque.

- Analyse des risques : identification et évaluation des risques de différentes natures susceptibles de générer des dommages et des préjudices à l’humain, ainsi que de leur causes et leurs conséquences.

- Maîtrise des risques : ensemble des barrières techniques, logicielles et humaines permettant de réduire ces risques à un niveau acceptable et ensemble des preuves et des garanties de performances et de traçabilité eu égard à aux objectifs d’acceptabilité.

Pour les systèmes d’IA identifiés comme à hauts risques (domaines des infrastructures critiques et transports, formation et éducation, médecine, emploi, services publics et privés essentiels, droits fondamentaux et répression, migration, administration, justice et démocratie), il sera notamment obligatoire de réaliser des analyses de risques pour fournir des plans de réduction et de gestion des risques, mais aussi d’apporter la preuve de la performance des IA et de leur sécurité.

La méthode AGR (Analyse globale des risques) déployée par MAD-Environnement, et que j’enseigne dans différentes formations de haut niveau (CentraleSupelecExed, Eurosae, Enac, CentralePekin, EIGSI, Université de Toulouse….), est parfaitement adaptée pour répondre à cet objectif, et nous l’avons déjà mise en œuvre sur des systèmes d’IA. Elle permet d’identifier et d’évaluer l’ensemble des dangers de nature très diverse (technique, sécuritaire, organisationnelle, éthique, opérationnelle, humaine….) générant des situations dangereuses, des événements redoutés, ainsi leurs causes et de leurs conséquences sur l’ensemble du cycle de développement, de déploiement et de maintenance d’un système d’IA. Et ainsi identifier et mettre en œuvre un plan d’action de management des risques adapté et efficient, d’un point de vue gouvernance, technique et économique. Les systèmes d’IA étant d’ores et déjà cibles et moteurs/vecteurs d’attaques cyber, l’AGR peut être couplée à une analyse EBIOS RM pour garantir la sécurité numérique. Et bien entendu le RGPD complète cette approche, à la fois pour les données utilisées par les modèles et les données des utilisateurs.

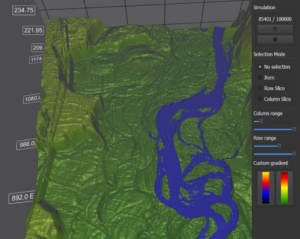

MAD-environnement développe également depuis 2007 une forte compétence en développement de systèmes d’IA, par la R&D (

https://mad-environnement.com/actus/ ), suivi d’un transfert vers l’opérationnel pour nos clients. Nous pouvons donc à la fois vous accompagner dans votre développement et expertiser vos systèmes d’IA.

Alliant compétences en management des risques et en développement d’IA, nous sommes donc votre partenaire idéal pour répondre à l’AI Act et faire de cette réglementation une opportunité et un atout majeur dans la réussite de vos projets d’IA.

Crédits Photos: NASA / JPL-Caltech / CNES / LANL / IRAP / IAS / CNRS[/caption]

Crédits Photos: NASA / JPL-Caltech / CNES / LANL / IRAP / IAS / CNRS[/caption]  Les systèmes d’IA connaissent actuellement un essor majeur dans tous les domaines de nos sociétés et sont sources d’opportunités dont probablement la majorité ne sont pas encore identifiées.

Les systèmes d’IA sont : (i) fondés des modèles mathématiques et des algorithmes dont la complexité rend difficile voire impossible une analyse formelle de leur fonctionnement ; (ii) utilisés pour prédire, générer des informations (textes, images, sons, codes, événements…) et prendre des décisions, avec de moins en moins de supervision humaine. Les prédictions et décisions générées par ces systèmes, quelles qu’elles soient, sont assorties d’incertitudes qui, si elles sont caractérisables par des métriques de performances, sont en revanche difficilement quantifiables, décelables et même reproductibles en utilisation opérationnelle. Par ailleurs, ces systèmes peuvent être intentionnellement orientés/biaisés à des fins politiques ou commerciales mais aussi utilisés pour générer des attaques cyber.

En réponse à ces enjeux majeurs qui bouleversent nos sociétés, et à l’instar du RGPD en 2016, l’Union Européenne a depuis 2021 développé l’AI Act, premier cadre juridique au monde visant vise à fournir un cadre explicite aux développeurs et deployeurs d’IA en Europe en formulant des exigences et des obligations qui dépendent de la nature et des objectifs du système d’IA concerné. On peut regretter au passage que les dommages environnementaux que pourraient générer des systèmes d’IA n’aient pas été considérés. Cette réglementation entre en vigueur en mai 2024.

Ce cadre réglementaire est construit sur une approche par la gouvernance, l’analyse et la maîtrise des risques.

Les systèmes d’IA connaissent actuellement un essor majeur dans tous les domaines de nos sociétés et sont sources d’opportunités dont probablement la majorité ne sont pas encore identifiées.

Les systèmes d’IA sont : (i) fondés des modèles mathématiques et des algorithmes dont la complexité rend difficile voire impossible une analyse formelle de leur fonctionnement ; (ii) utilisés pour prédire, générer des informations (textes, images, sons, codes, événements…) et prendre des décisions, avec de moins en moins de supervision humaine. Les prédictions et décisions générées par ces systèmes, quelles qu’elles soient, sont assorties d’incertitudes qui, si elles sont caractérisables par des métriques de performances, sont en revanche difficilement quantifiables, décelables et même reproductibles en utilisation opérationnelle. Par ailleurs, ces systèmes peuvent être intentionnellement orientés/biaisés à des fins politiques ou commerciales mais aussi utilisés pour générer des attaques cyber.

En réponse à ces enjeux majeurs qui bouleversent nos sociétés, et à l’instar du RGPD en 2016, l’Union Européenne a depuis 2021 développé l’AI Act, premier cadre juridique au monde visant vise à fournir un cadre explicite aux développeurs et deployeurs d’IA en Europe en formulant des exigences et des obligations qui dépendent de la nature et des objectifs du système d’IA concerné. On peut regretter au passage que les dommages environnementaux que pourraient générer des systèmes d’IA n’aient pas été considérés. Cette réglementation entre en vigueur en mai 2024.

Ce cadre réglementaire est construit sur une approche par la gouvernance, l’analyse et la maîtrise des risques.